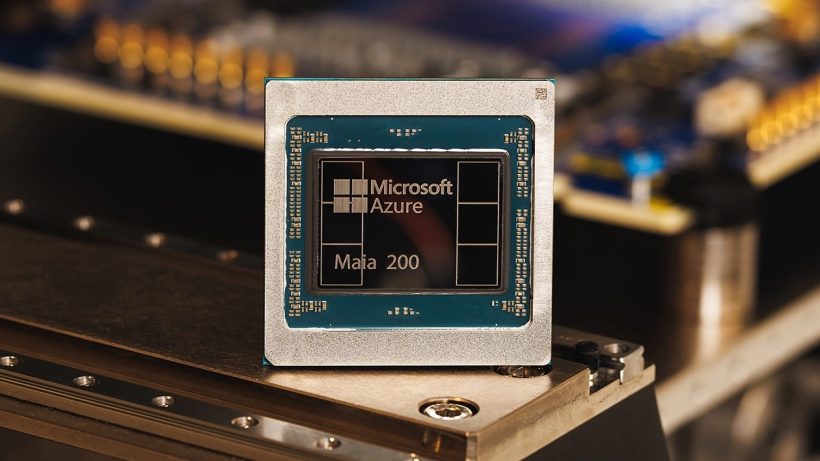

Microsoft Maia 200 — ИИ-чип с 216 ГБ HBM3e, TDP 750 Вт и 10 PFLOPS

02.02.26

Microsoft официально анонсировала свой серверный ШИ-ускоритель Azure Maia 200 – чип второго поколения линейки Maia, разработанный специально для инференса моделей искусственного интеллекта. Компания называет его самой эффективной инференс-системой в своей истории и заявляет о примерно 30% более высокой производительности на каждый израсходованный доллар по сравнению с Maia 100.

Архитектура и техпроцесс

Maia 200 производится по 3-нм техпроцессу TSMC и содержит около 140 млрд транзисторов. По данным Microsoft, чип обеспечивает до 10 петафлопс производительности в вычислениях FP4, что примерно втрое превышает показатели Amazon Trainium3. Ускоритель оснащен 216 ГБ памяти HBM3e с пропускной способностью 7 ТБ/с, а также имеет 272 МБ встроенной SRAM.

Подход к работе с памятью

Отдельный акцент компания сделала на архитектуре памяти. Встроенная SRAM разделена на Cluster-level SRAM (CSRAM) и Tile-level SRAM (TSRAM). Такое разделение позволяет более эффективно балансировать нагрузку между быстрой локальной памятью и HBM, что положительно влияет на стабильность и энергоэффективность при работе с форматами FP4 и FP8, которые являются ключевыми для современных инференс-моделей.

Энергопотребление и эффективность

Несмотря на то, что заявленный TDP Maia 200 на 50% выше, чем у Maia 100, Microsoft утверждает, что общая энергоэффективность возросла. Для сравнения, Nvidia Blackwell B300 Ultra имеет TDP около 1400 Вт, в то время как Maia 200 работает на уровне 750 Вт. В то же время Maia 100, номинально рассчитывавшийся на 700 Вт, на практике потреблял около 500 Вт.

Сравнение с конкурентами и позиционирование

Непосредственно сравнивать Maia 200 с решениями Nvidia компания не берется, поскольку чип не продается сторонним клиентам, а программная экосистема Nvidia остается значительно более зрелой. Впрочем, с точки зрения энергоэффективности собственное решение Microsoft выглядит убедительно — особенно на фоне растущего внимания к экологическому влиянию ИИ и потреблению электроэнергии датацентрами.

Развертывание в датацентрах Azure

Ускорители Maia 200 уже работают в датацентре Azure US Central. В ближайшее время Microsoft планирует расширить их использование в US West 3 (Финикс, Аризона), а также в других локациях. Чипы станут частью гибридной инфраструктуры, где Maia 200 будет работать вместе с другими ши-ускорителями Azure.

Не пропустите интересное!

Підписывайтесь на наши каналы и читайте анонсы хай-тек новостей, тестов и обзоров в удобном формате!

Обзор смартфона Oppo A6 Pro: амбициозный

Новый смартфон Oppo A6 Pro — телефон среднего уровня с функциональностью смартфонов премиум-класса. Производитель наделил его множеством характеристик, присущих более дорогим телефонам. Но не обошлось и без компромиссов. Как именно сбалансирован Oppo A6 Pro – расскажем в обзоре.

Обзор смартфона Oppo Reno 15 5G: уверенный

Смартфон Oppo Reno15 делает ставку на дизайн, качественный дисплей, универсальные камеры и хорошую автономность. Расскажем подробнее

Microsoft добавила в Блокнот поддержку изображений Microsoft обновление

Microsoft продолжает расширять возможности обновлённого «Блокнота» в составе Windows 11. Следующим шагом может стать поддержка изображений

ASUS и Acer прекратили продажу ноутбуков и работу сайтов в Германии из-за выигрыша Nokia в суде Acer Asus Nokia события в мире суд

В 2025 году компания Nokia подала параллельные иски против Acer, Asus и производителя телевизоров Hisense в Мюнхенский региональный суд и Единый патентный суд